Reddit のホットトピック: あなたも NLP の現状に失望していますか?

|

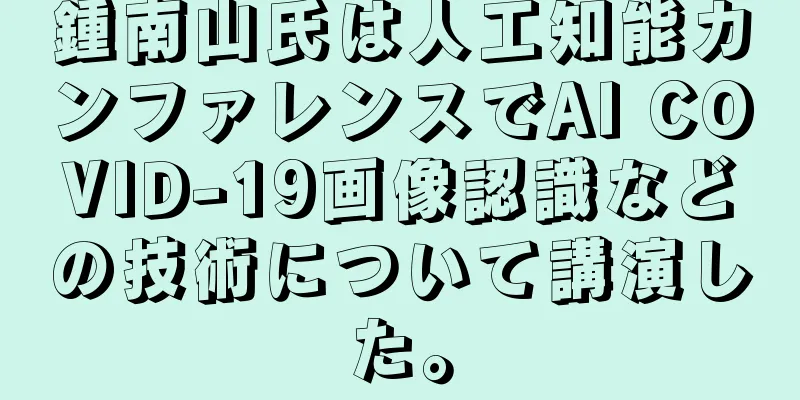

ご存知のとおり、自然言語処理 (NLP) とコンピューター ビジョン (CV) は、人工知能の 2 つの注目分野です。近年、ディープラーニングなどの技術の発展により、コンピュータービジョンの分野は急速に発展し、ますます多くのアプリケーションが実装され始めています。これと比較して、NLP 分野の現在の進歩はどうでしょうか? 昨日、Reddit で誰かが質問しました。「NLP のブレークスルーにはまだ遠いのでしょうか?」この質問は白熱した議論を引き起こしました。

質問 私は自然言語処理(NLP)の分野における進歩に少しがっかりしています。 2014年から2015年にかけて、NLPでは外部メモリ、推論、教師なし/半教師あり学習、チャットボット、質問応答システム、画像のテキスト説明の生成など、多くの興味深い開発がありました。しかし、今日では、それらの多くはほとんど進歩していないようで、人々の研究の焦点はGANと強化学習に移っています。 そう思いますか? NLP の分野におけるブレークスルーについて語るのはまだ早すぎますか? 回答とディスカッション Jean-Porte: 現在の最高の結果は着実に増加しています。 SNLI で人間の最善のアプローチを上回るなど、いくつかの結果は印象的ですが、これが真の人間のパフォーマンスであるとは思いません。機械学習カンファレンス (ICLR) での NLP 論文は非常に少ないものの、教師なし学習は NLP で成功を収めています (教師なし機械学習を紹介する ICLR 論文が 2 つあります)。多くの効率的な方法も開発中です (fasttext など)。 2014 年から 2015 年にかけて、多くの新しい興味深い難しい問題が、かなり良い結果で解決されたと思います。この分野はこれらの問題に関して成熟しつつあり、過去ほど画期的ではないものの、確実に進歩しています。

hapliniste:本当に優れた NLP は私たちが考えるよりもはるかに難しいと思います。おそらく、汎用人工知能 (AGI) が実現されるまでは実現しないでしょう (言語が現実世界から生まれるのと同じように、この世界を理解しなければ機能しないのは確かです)。 adammathias:おっしゃる通り、NLP は非常に難しいです。タスクが難しいだけでなく (もちろん、これは選択したタスクにも依存します)、結果を分析して特徴付けるのはさらに困難です。多くのグラフィックス タスクにおける中間層の出力の視覚化は、一部のコンピュータ アートと同様に、あらゆる研究委員会、エンジニアリング マネージャー、さらにはニューヨーク タイムズの読者からも承認されるでしょう。 しかし、2 つの文の平均である文はどうでしょうか。あるいは、ベクトル空間内の点から生成された文はどうでしょうか。これは、トレーニング データが英語であることを前提としています。その結果、すべてがさらに困難になります。参入障壁が高ければ高いほど、すぐに得られる報酬は低くなります。そのため、多くの研究者が研究分野を変え、徐々に妥協するようになりました。 具体的な例として、世界トップクラスの研究・エンジニアリング組織の非常に才能があり、善意があり、非常に有能な同僚に対して、なぜ「Блацк �орест」や「тхроугх」が受け入れられない成果であり、完全な失敗であるのかを説明するのは、信じられないほど困難な戦いです。 5年経った今でも、これはまだ存在しています。これは非常に単純な問題で、データ チャネルのバグのようなもので、実際には非常に簡単に解決できます。 hapliniste:はい、言語処理が大きな問題であることには同意します。ネットワーク内の情報ルーティングを制御する「海馬」を作成できれば、強力な NLP を開発するための強固な基盤が得られますが、これは実現にはほど遠いようです。 「AGI」と NLP を実現する方法に関する私の現在の見解は次のとおりです。

しかし、あまり真剣に受け止めないでください。これらはまだ証明されていない意見です。 私が「AGI」について話したことに注意してください。しかし、多くの人が AGI を進化のプロセスの結果であり、生きているものだと考えているようです。しかし、私のアプローチではこの種の AGI が実現される可能性は低いでしょう。おそらく、人間が設計したモデルが教師あり方式でタスクを解決するアプリ ストアのようなものになるでしょう (そのため、AGI ではなく「AGI」と呼びます)。 adammathias: 2017 年第 4 四半期に関しては、私たちは何も試みませんでした。ニースのトラック攻撃、ローマ法王の同性愛者に対する小さな一歩、PR を愛すること、言語における文の半分を省略すること (今日の例) など、現実世界のタスクは、追加のコンテキストの助けがなければ達成できません。しかし、ベンチマークの大半にはコンテキストが含まれていません。たとえスーパーニューラルネットワークがあり、トレーニングとテスト中にこのような文字列を入力したとしても、ネットワークが機能するとは期待できません。ある意味、今日の機械学習のパフォーマンスは、与えられた入力に対してほぼ最適です。 Google Now やその他の類似アプリは、その約束を果たすためにコンテキストを活用しており、マニング氏のスタンフォード研究室は繰り返しに重点を置いている。コンテキスト データセットを作成する際にも課題があります。十分な大きさのデータセットを作成する必要がありますが、うまく転送できない可能性があります。このようなデータセットが利用可能になると、自然言語に関する AGI 研究がさらに進むでしょう。 automated_reckoning:素晴らしい例ですね。頭の中で意味が簡単に変わるのは興味深いですし、文脈がいかに重要か、自然言語がいかに微妙であるかがよくわかります。 adammathias:クリス・マニングの「教皇の小さな一歩」の例: AI の未来 – 2016 年 6 月 23 日 – https://vimeo.com/173057086。 アダマティアス:

実際のところ、それは NLP ではありません。

これまでGoogle、IBM、Microsoftなどの企業が発表した会話対会話のデモしか見たことがありませんが、最も目を引くのは音声認識技術であり、すべてがNLPというわけではありません。現在、ベイエリアで機械翻訳を本当に必要としている企業はどれくらいあるでしょうか? NMT の実際のユーザー グループは、英語を話さないが、仕事や生活で英語を使用する必要がある人々です。 mljoe:コンピューター ビジョンに存在する典型的なスタッキングとプーリングのアプローチ以外のものが必要だと思います。上記の方法は、物理世界の構造の本質を捉えることができます(Henry W. Lin らによる論文「なぜディープラーニングと安価な学習はこれほどうまく機能するのか?」より引用)。しかし、自然言語では機能しないと思います。ジェフリー・ヒントンのカプセルコンセプトは、NLP に新たな希望をもたらすかもしれないと思います。 Syphon8:自然言語処理の性質についてもう少しお話ししましょう。これは、人間をどう見るかということと関係があり、実は一般的な人工知能と同じ問題なのです。 これはサピア=ウォーフ仮説の再来に過ぎないのかもしれないが、私はその可能性が高いと思う(サピア=ウォーフ仮説:言語学者で人類学者のエドワード・サピアとその弟子のベンジャミン・ウォーフが提唱した人間の言語に関する仮説。心理学と言語学の仮説である。人間の思考パターンは使用する言語の影響を受け、そのため同じものに対して異なる見解を持つ可能性があるとしている)。 人間のように自然言語を処理できる機械であれば、対応する意見を持ち、その言語で記述されたタスクを実行できます。 同様に、真の人工知能は、他のインテリジェントエージェントと対話するために、ある程度の言語処理能力を備えている必要があります。 torvoraptor:最近の論文を見ると、すでに教師なしニューラル機械翻訳が存在しており、NLP 分野が停滞しているとはまったく思えません (Word Translation Without Parallel Data: https://arxiv.org/abs/1710.04087) - 教師なしニューラル機械翻訳: 単一言語コーパスのみを使用する eMPiko:これは残念なことではなく、むしろ警告だと思います。何か興味深い新しい発見があると、20 年以内に汎用人工知能を実現すると自慢する人が必ずいます。 Deep NLP は、ほぼすべての NLP タスクで最先端の結果を達成する、かなり汎用的で再利用可能なアーキテクチャを使用して、大きな進歩を遂げました。私たちは、わずか数年で数十年の研究成果を上回りました(場合によっては、たとえば、2015 年以前に統計的機械翻訳を使用した研究の進歩はすべて、データ駆動型のエンコーダー/デコーダーの使用が開始されたため、事実上無関係になっています。 フィリダ:あの論文は気に入りました。残念ながら、私の知る限り、通常の機械翻訳とは異なり、チャットボットに転送することはできません。 evc123:状況言語学習が適用されるまで、NLP は衰退し続けるでしょう: https://arxiv.org/abs/1610.03585。 postponedwithnlp:これは現在のジレンマに対する解決策ではないと思います。 エージェントが知っていること以上のことを学習することは不可能であるため、他のエージェントから学習するエージェントには制限があります。人間から学習するエージェントは、他のものを学習するときに非常にサンプル効率が高くなければなりません。したがって、サンプルを効率的に使用するために、まずはより優れた教師なし学習機能が必要です。 NLP の現在の発展についてどう思いますか? お気軽にメッセージを残して議論してください。 |

>>: Google、チャットボットデータ分析プラットフォーム「Chatbase」の開設を発表

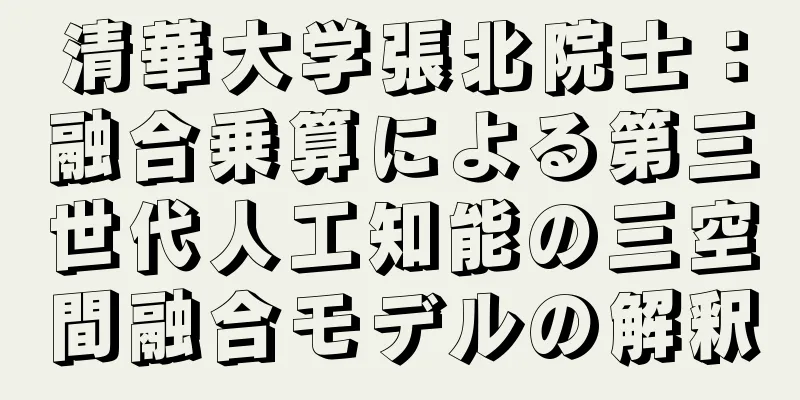

推薦する

アリババ・ダモ・アカデミーは、電力網の負荷を正確に予測するための新しい時系列予測モデルを提案している。

この記事はAI新メディアQuantum Bit(公開アカウントID:QbitAI)より許可を得て転載...

天才少年・志慧君が志遠ロボットとともに会場に入場!脳としてAIモデル、目標価格は20万以下

Huaweiの才能あふれる若者Zhihuiの起業家デビューがついに登場!観衆の注目が集まる中、「Ex...

自動運転は「終焉」に向かっている

技術導入への困難な道のりは、特定の客観的な法則に従わなければならず、それはいかなる利害関係者の意見に...

ビジネスの自動化は、企業のデジタル変革における重要な課題となっている。

多くの企業が、ロボティック・プロセス・オートメーション(RPA)を監督することを主な責務とする最高オ...

アルゴリズム学習のための動的プログラミング戦略の紹介

1. コンセプト動的プログラミング戦略、分割統治戦略。貪欲戦略と同様に、通常は最適解問題を解決するた...

製造業者はデジタルツインをどのように活用して生産性を向上できるでしょうか?

メーカーは、競争上の優位性を獲得し、コストを削減し、顧客によりカスタマイズされた体験を提供するために...

古い写真の修復、太陽系外惑星の発見... 素晴らしい機械学習プロジェクト 8 つをご紹介します

[[337579]]カジャル・ヤダブマシンハートが編集編集者: シャオ・ジョウ、ドゥ・ウェイ人工知能...

AIoT: トーク

AIoT とは何ですか? 何ができるのでしょうか? これらは、今日の記事で取り上げる質問です。本質的...

人工知能の時代にITキャリアを築く方法

人工知能(AI)技術がより高度になるにつれ、ITプロフェッショナルは将来、AIに対して優位に立つため...

組み込み物流ロボットの用途は何ですか?

ネットワーク技術やグリッドコンピューティングの発展により、組み込み型モバイル機器を中核とした「ユビキ...

規制がなければ、AIは金融危機を引き起こす可能性がある

人工知能の影響はビジネス界のほぼすべての側面に広がっており、金融業界も例外ではありません。金融業界の...

人工知能の力がどのように販売業界に革命をもたらしているか

販売業界が進化し続けるにつれて、販売チームが新規顧客を引き付け、既存顧客を維持するのに役立つ販売戦略...