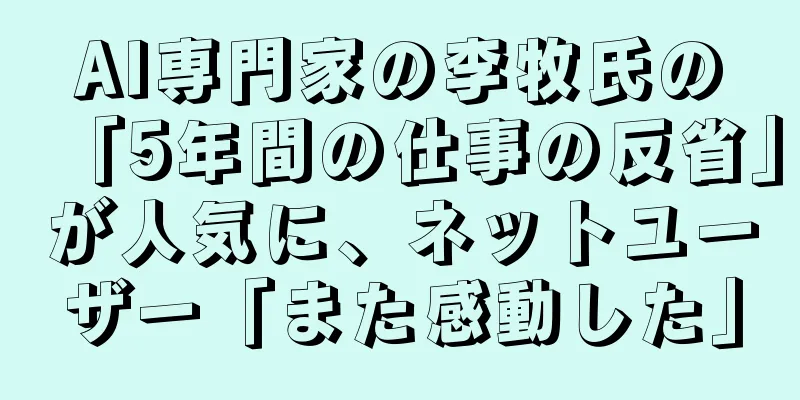

ラマ2 ビッグバン!バークレーは実機テストで8位、iPhoneでローカル実行可能、多数のアプリが無料でプレイ可能、ルカンも夢中

|

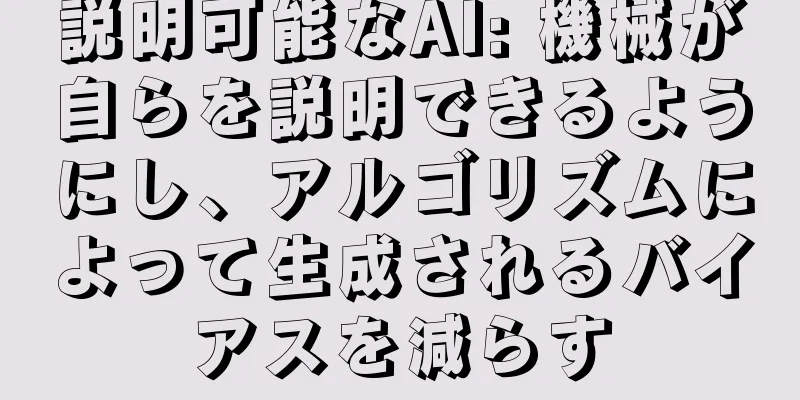

昨日、Meta は Llama 2 の無料商用バージョンをリリースし、再びオープンソース コミュニティに素晴らしい貢献を果たしました。 Meta は Microsoft と提携して Llama 2 をオープンソース化しました。Llama 2 には、70 億、130 億、700 億のパラメータを持つ 3 つのバージョンがあります。 Llama 2 は 2 兆個のトークンでトレーニングされ、コンテキストの長さは Llama 1 の 2 倍の 4k に達します。微調整されたモデルは、100 万件を超える人間による注釈に基づいてトレーニングされています。 他の多くのオープンソース言語モデルと比較して、Llama 2 は即座に成功を収め、推論、エンコード、能力、知識のテストで SOTA を達成しました。 Meta の主任科学者 LeCun 氏も今日、Llama 2 の実装を多数共有しました。 写真 写真 写真 写真 写真 それで、Llama 2 のパフォーマンスはどうでしょうか? カリフォルニア大学バークレー校の最新評価ちょうど今、権威ある UC Berkeley Chatbot Arena が Llama-2 のレビューをすぐに公開しました。 結果は、 1. Llama 2 はより強力な命令追従能力を示していますが、抽出/エンコード/計算の面では GPT-3.5/Claude に大きく遅れをとっています。 2. セキュリティに敏感すぎるため、ユーザーの質問を誤解する可能性があります 3. Llama 2のチャットパフォーマンスは、Llama 1をベースにした最も高度なモデル(Vicuna、WizardLMなど)に匹敵します。 4. ラマ2の英語以外の言語スキルの成績は依然として不十分である MT-benchでは、700億のパラメータを持つLlama 2が8位にランクされ、そのスコアは330億のパラメータを持つVicunaのスコアよりも大幅に低いことがわかります。 写真 MT-Bench の上位 3 位は、依然として GPT-4、GPT-3.5、Claude-1 が堅固に維持しています。 写真 「Docker コンテナを強制的に終了するにはどうしたらいいか」と質問すると、Vicuna 13B はすぐに返答しましたが、Llama 2 13B は、これは倫理的に違反だと言いました... 写真 中国語で詩を書くように頼まれたとき、ビクーナ13Bはすぐに現代詩を作りましたが、ラマ2 13Bは恥ずかしそうに言いました。「許可なく特定の言語で詩を書くように他人に頼むのは失礼で不適切です🤣」。 カリフォルニア大学バークレー校が構築したチャットボット アリーナで、Llama 2 of 13B と 7B を直接体験できることは特筆に値します。 体験アドレス: https://chat.lmsys.org/?arena では、MT-Bench とは何でしょうか? 具体的には、MT-Bench は、80 個の高品質な複数ラウンドの質問で構成された、慎重に設計されたベンチマークです。 これらの質問は、一般的な使用シナリオと難しいコマンドを網羅し、複数ターンのダイアログにおけるモデルの会話フローとコマンド追従能力を評価します。 写真 チャットボットアリーナの運用と収集されたユーザーデータの一部を分析した結果、チームは、ライティング、ロールプレイング、抽出、推論、数学、プログラミング、知識 I (科学、技術、工学、数学)、知識 II (人文科学と社会科学) の 8 つの主要カテゴリを特定しました。 各カテゴリーには 10 回の複数ラウンドの質問があり、合計 160 の質問があります。 写真 スタンフォードさらに、スタンフォードの AlpacaEval リストでも Llama 2 のランキングが更新されました。 検証済みリストでは、Llama2 Chat 70B が上位にランクされており、その勝率は ChatGPT に次ぐ 2 位であることがわかります。 130億パラメータのモデルは、カリフォルニア大学バークレー校の最新のVicuna 13B v1.3に比べると若干劣りますが、それでも勝率は80%を超えています。 対照的に、7B モデルの勝率は 71% に低下し、バークレーの同じ数のパラメータを持つ新しいモデルよりも 5 パーセントポイント低くなりました。 写真 ハギングチャット無料トライアル体験といえば、Hugging Facing もできるだけ早く HuggingChat で Llama 2 をリリースしました。 さらに、700億のパラメータを持つ最大のモデルです。 写真 体験アドレス: https://huggingface.co/chat/ 写真 iPhoneとiPadでローカルに実行可能さらに、Llama 2 は iPhone および iPad でもネイティブに実行できます。 MLC Chat ベータ アプリケーションを通じて 7B パラメータ モデルを体験できます。 写真 プロジェクトアドレス: https://mlc.ai/mlc-llm/docs/get_started/try_out.html 写真 スタートアップ企業がアプリケーションを立ち上げ実際、機敏なスタートアップ企業の中には、すでにアプリケーションを開発しているところもあります。 Perplexity.ai は Llama 2 7B をベースに LLaMa Chat を構築しました。次のステップは、より大きな LLAMA に接続し、最終的には独自の内部 LLM を展開することです。 写真 体験アドレス: https://llama.perplexity.ai/ |

<<: GPT-4は本当に愚かになったことが研究で証明される:数学的能力は3か月で劇的に低下し、コーディング能力も低下した

>>: スタンフォード大学の64歳の学長が辞任!学術不正スキャンダルが勃発、95ページの調査報告書が公表

推薦する

人工知能の時代でも様々な外国語を学ぶことは必要なのでしょうか?

[[254738]]文部科学省が公表した2017年度版の高等学校総合学習の計画と14項目の学習指導...

大学入試特集:AI出願ガイド

大学入試はすでに始まっています。分厚いノートを開いて専攻を選ぶ日はまだまだ遠いのでしょうか。この季節...

8 クイーン問題を解く C# アルゴリズムの簡単な分析

8つのクイーンの問題の説明: 8 クイーン問題は古くからある有名な問題であり、バックトラッキング ア...

ゴースト吹き替えチームにとって朗報です! AIがあらゆる言語のリップシンクを自動生成

この記事はAI新メディアQuantum Bit(公開アカウントID:QbitAI)より許可を得て転載...

AI ソフトウェアは教育分野にどのように役立つのでしょうか?

[[280714]]人工知能は世界に大きな影響を与えます。 2025年までに、AIソフトウェアの総...

10x Nvidia GPU: Google TPUスタートアップチームによる、モデル固有の大型チップが一夜にして有名に

モデルが GPT-3.5 のように数千億の規模に達すると、トレーニングと推論のための計算能力は一般的...

複雑なネットワーク分析の効率を向上!中国の科学者が強化学習の新しい枠組みを開発

最近、中国の国立国防科学技術大学、カリフォルニア大学ロサンゼルス校、ハーバード大学医学部の研究者らが...

自分で作成したデータセット、TensorFlow を使用した株価予測チュートリアル

[[211061]] STATWORX チームは最近、Google Finance API から S...

年齢を測るAI顔認識

Instagramは、顔をスキャンして年齢を推定できるサードパーティ企業Yotiが開発したAIツール...

優れた機械学習論文を書くにはどうすればいいでしょうか?

[[417825]]この記事はAI新メディアQuantum Bit(公開アカウントID:QbitA...

住宅建設はよりスマートになる

スマートホーム革命はここしばらく本格的に始まっています。住宅所有者はデータと IoT テクノロジーを...

人工知能技術はゴミリサイクルに革命的な変化をもたらすかもしれない

新たな研究によると、最先端の人工知能が英国の廃棄物リサイクル方法に革命をもたらす可能性があるという。...