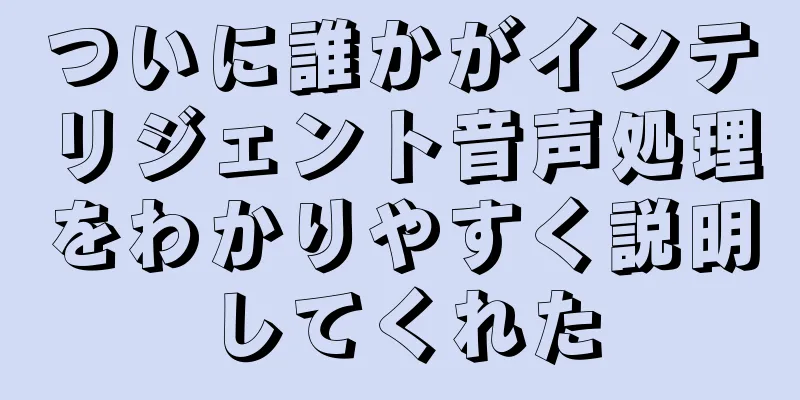

「ブラック」AI | 新たなAIサイバー攻撃のトップ10をチェック

|

今日、人工知能技術の急速な発展は、さまざまな分野に前例のない変化と進歩をもたらしています。その中には、2023 年上半期の「トップ プレーヤー」である生成 AI と ChatGPT が含まれています。 ChatGPTの人気により、AIの驚くべきパフォーマンスの明るい面が人々に知られるようになりましたが、同時に、暗い面も密かに力を発揮し、急速に成長しています。 AI テクノロジーは、ネットワーク セキュリティの維持に使用できるだけでなく、悪意のある第三者が AI ネットワーク攻撃を仕掛けるためにも使用される可能性があります。 AI サイバー攻撃により、プライバシー、セキュリティ、倫理的問題に関する懸念が高まっています。 AI 攻撃は、ハッカーが AI 技術を使用して犯罪行為を実行するだけでなく、誤解を招く情報やソーシャル エンジニアリングなどの他の潜在的な脅威も含まれます。 最も人気のある新しい AI サイバー攻撃手法のトップ 10 を見てみましょう。 AI毒攻撃人工知能の大規模な利用は、従来のデータセキュリティ問題を加速させると同時に、過剰なデータ収集によるセキュリティ問題をさらに悪化させ、「データポイズニング」などの新たなデータセキュリティ問題さえ生み出しています。 一般的に、AI ポイズニングとは、攻撃者がトレーニング データに慎重に構築された異常なデータを追加して、トレーニング データの元の確率分布を破壊し、特定の条件下でモデルが分類またはクラスタリング エラーを起こすようにすることで、トレーニング データ セットと精度を破壊することを指します。 その中で最も一般的なポイズニングの形態は、たとえトレーニング データのごく一部のみが影響を受ける場合でも、バックドア ポイズニングです。 AI モデルは、特定のトリガーによって「起動」されて誤動作するまで、長期間にわたって高精度な結果を出し続けます。 場面に適応するデータ ポイズニング攻撃では、攻撃者がトレーニング データにアクセスする必要があるため、通常、オンライン学習シナリオや、モデルを更新するために定期的な再トレーニングが必要なシステムで効果的です。一般的なシナリオには、推奨システム、適応型生体認証システム、スパム検出システムなどがあります。データ ポイズニング攻撃のプロセスは、次の 3 つの段階に分けられます。 1. 攻撃を受けたモデルの出力特徴に基づいて、代替のトレーニング セットを選択し、同じ入力で同じ出力を持つモデルをトレーニングします。たとえば、猫と犬の分類。 2. 悪意のあるサンプルのセットを初期化し(ソースに関係なく)、勾配更新(勾配上昇戦略などの損失関数を必要に応じて構築)を使用して、目的の効果が達成されるまで悪意のあるサンプルを更新します。 3. 悪意のあるサンプルセットを攻撃モデルのトレーニングセットに入れる 「AI モデル汚染」は、AI アプリケーションの整合性とセキュリティに深刻な脅威をもたらします。その結果、大規模言語モデル (LLM) は、リスクと安全性の研究者による厳格な精査を受け、フィードバック ループや AI バイアスなどの問題が AI 出力の信頼性を低下させる原因となる可能性を探る必要があります。 AI生成マルウェアサイバーセキュリティの世界では、脅威の主体が人工知能を利用する潜在的な脅威が警鐘を鳴らし続けています。特に、AI ツールを使用してマルウェアを作成することが現実になった今ではなおさらです。 研究者らは、生成AIを使用すると、ハッカーがマルウェアを作成し、標的のシステムの脆弱性を迅速に発見し、他の自動化技術を使用する場合よりもさらに攻撃を高速化および拡大できることを発見しました。 これは、SANS が「2023 年の最も危険なサイバー攻撃トップ 5」として挙げているもう 1 つの大きな脅威です。 RSAC 2023カンファレンスで、SANSの脆弱性研究者であるSteven Sims氏は、非専門家の犯罪者でさえChatGPTを使用してランサムウェアコードを生成しようとし始めており、特定のコードセグメントでChatGPTによって自動的に生成されるゼロデイ脆弱性を発見したことを実証しました。 AIデータプライバシー攻撃AI アプリケーションでは、データのプライバシーと情報セキュリティが主な懸念事項の 1 つです。大規模なデータの収集・保管に伴い、個人情報漏洩やハッカー攻撃のリスクが高まっています。データの偏りやアルゴリズムの不公平さは不公平な決定や影響につながる可能性があるため、AI アルゴリズムにおける偏りや差別の問題は広く注目を集めています。 同時に、ソーシャルエンジニアリングや詐欺もAI応用における課題となり、虚偽の情報やオンライン詐欺の増加が社会に悪影響を及ぼしています。 AI モデルに適切なプライバシー対策が組み込まれていない場合、攻撃者がこれらのモデルのトレーニングに使用されるデータの機密性を侵害する可能性があります。そうなると、企業が AI をどのように活用し、それがデータにどのような影響を与えているかを個人が理解することが重要になります。攻撃者は、マルウェアを使用して、クレジットカード番号や社会保障番号などの個人情報を含む機密データセットを盗もうとする可能性もあります。プライバシーリスクはデータライフサイクルのどの段階でも発生する可能性があるため、すべての関係者に対して統一されたプライバシーセキュリティ戦略を策定することが重要です。 武器化モデルモデルの武器化とは、人工知能モデルや機械学習モデルを悪意のある目的や攻撃的な行動に適用するプロセスを指します。通常、この行為は違法かつ破壊的であり、プライバシーの侵害、システムの妨害、ユーザーの欺瞞、その他の悪意のある行為を目的としています。 武器化されたモデルは、ネットワーク攻撃、プライバシー侵害、ソーシャル エンジニアリングなどのさまざまな攻撃シナリオで使用される可能性があります。 フィッシング攻撃では、自然言語処理モデルを使用して偽の電子メールやソーシャル メディア メッセージを作成し、ユーザーを騙して個人情報を提供させたり、悪意のあるアクションを実行させたりします。 機械学習モデルを使用して、金融取引における不正防止システムの回避など、他のシステムに対する不正を検出します。機械学習モデルを使用して、システムに侵入したり、情報を盗んだり、損害を与えたりする可能性のあるマルウェアを分類および識別します。 さらに、この方法は、機械学習や適応型アルゴリズムを使用してシステムやアプリケーションの脆弱性を自動的に検出して悪用し、自動化された脆弱性スキャンや悪用などの攻撃を開始するなど、自動化されたネットワーク攻撃にもよく使用されます。 武器化されたモデルは、自然言語処理モデルを活用して偽のニュース記事、ソーシャルメディアの投稿、コメントを生成し、世論を操作したり混乱を引き起こしたりすることで、偽のニュースや偽情報を広めるためにもよく使用されます。 兵器化されたモデルの存在は、人工知能と機械学習技術の適切な使用に関する懸念を引き起こします。この脅威に対抗するために、研究者と業界は、セキュリティ分析の強化、規制管理の強化、およびユーザーの意識向上に重点を置き、武器化されたモデルのリスクと悪用を減らす必要があります。 スポンジ攻撃 2023 年の RSAC カンファレンスでは、今後数年間に CISO が直面することになる AI のリスクと回復力の問題について議論するパネルが取り上げられました。議論されたトピックの中で最も注目を集めたのは、新たな攻撃であるスポンジ攻撃でした。 スポンジ攻撃では、攻撃者は構造の弱点を狙ってスポンジのセキュリティを侵害します。攻撃の目的は、与えられた入力から特定のプロパティを持つ出力を生成することです。攻撃者は、適切な入力データを選択して特定の変更を加え、出力データからのフィードバックを観察して変更プロセスをガイドすることで、この目的を達成します。 このタイプの攻撃では、攻撃者は特別に細工された入力を通じてモデルのハードウェア リソースを消費し、AI モデルに対してサービス拒否攻撃を実行できます。 CalypsoAIのCEO、ニール・セレブリアニー氏は、この攻撃はニューラルネットワークにさらなる計算を行わせ、システムの利用可能な計算リソースを超え、システムをクラッシュさせようとするものだと語った。 AI大規模モデル窃盗攻撃AI 大規模モデル盗難攻撃は、人工知能分野を標的としたセキュリティ上の脅威です。攻撃者は、独自のモデルをゼロからトレーニングすることなく、重みとパラメータを取得して、トレーニング済みの大規模な AI モデルの知識と機能を取得しようとします。 この攻撃は主に次の 2 つの方法に基づいています。

攻撃者は、AI テクノロジーのアプリケーション展開からデータを盗むだけではありません。さまざまな攻撃方法を通じて、AI モデルの動作原理を解読することもできます。 AI 大規模モデル盗難攻撃により、攻撃者はモデルが学習したデータの特徴やパターンなど、モデルの知識や機能を入手できるようになります。これにより、元のモデルのビジネス秘密が漏洩する可能性があり、競争における技術的優位性の喪失にもつながる可能性があります。 さらに、攻撃者が企業や組織の中核となる AI モデルにアクセスできれば、このモデルを利用して競争市場で不当な優位性を獲得したり、モデルを悪用して悪意のある動作を引き起こしたりして、組織の競争上の優位性を弱めることができます。 大規模な AI モデル盗難攻撃を防ぐために、開発者や研究者は、トレーニング データとモデルの重みの暗号化、モデル インターフェイスへのアクセスの制限、モデル透かしテクノロジの使用など、いくつかのセキュリティ対策を講じることができます。さらに、研究者たちは、モデル盗難のリスクを軽減するために、より安全な AI モデルの設計とトレーニング方法も模索しています。 AI技術の研究と革新には高度なチームワークと反復的な開発が必要であり、そのためデータ共有やモデル共有など多くの共有が伴い、AIサプライチェーンに重大なリスクをもたらす可能性があります。研究者らは最近、AI 攻撃の新しいパターンを発見しました。この攻撃では、攻撃者はまず公開コード リポジトリ上の正当な AI モデルを乗っ取り、次にこれらの事前トレーニング済みの AI モデルに悪意のあるコードを埋め込んで、悪意を持ってモデルを改変します。ユーザーがこれらの改変された AI モデルをリロードすると、攻撃者はランサムウェア攻撃などの違法行為を実行できます。 インジェクション攻撃のヒント:プロンプト インジェクション (Pi) 攻撃は、AIGC 大規模言語モデルによって引き起こされるコンテンツ セキュリティ、データ セキュリティ、およびその他のリスクの重要な原因の 1 つです。 ヒント インジェクションは、特定の AI/ML モデルに影響を及ぼす新しいタイプの脆弱性です。本質的には、人間の指示に従う機械学習モデルを悪意のあるユーザーが提供する指示に従うようにトレーニングすることでモデル出力を乗っ取り、モデル自体によって実装されたコンテンツ生成ルールの制限を突破するプロセスです。 開発者が ChatGPT やその他の大規模言語モデル (LLM) をアプリケーションに統合すると、これらの悪意のあるプロンプトが AI モデルによって処理され、Web サイトに不正なコンテンツを投稿したり、違法または扇動的な情報を含む可能性のある電子メールを作成したりするなど、安全でないアクションがトリガーされる可能性があります。 エスケープ攻撃回避攻撃は現在最も典型的な敵対的 AI 攻撃の 1 つです。攻撃者は、制限された環境から脱出し、昇格された権限やより広範なアクセス権を取得して機密情報を入手したり、不正な操作を実行したりしようとします。 攻撃者が回避攻撃を実行するために意図的に構築するサンプルは、通常「敵対的サンプル」と呼ばれます。AI モデルの識別メカニズムに欠陥がある限り、攻撃者は AI モデルを欺くために敵対的サンプルを構築できる可能性があります。 研究者たちは、コンピューター上で人間の視覚機能を模倣しようと試みてきました。しかし、人間の視覚メカニズムは複雑すぎるため、物体を判断する際に2つのシステムが頼りにするルールには一定の違いがあります。 この回避攻撃は、オペレーティング システム、仮想化プラットフォーム、コンテナー、ブラウザー、モバイル デバイスなど、さまざまなシステムやアプリケーションで発生する可能性があります。攻撃者は、システムの脆弱性、誤った構成、または欠陥のある制御メカニズムを悪用し、悪意のあるコードを挿入し、権限を昇格し、セキュリティ制限を回避し、システムまたはその他のリソースを完全に制御することで、制限された環境から「脱出」することに成功します。 エスケープ攻撃は、攻撃者がより高い権限を取得し、さまざまなセキュリティ メカニズムやアクセス制限を回避できるため、非常に有害です。攻撃者が脱出に成功すると、機密データへのアクセス、システム構成の改ざん、通信の傍受、マルウェアのインストールなどの悪意のある操作を実行し、システムとユーザーに重大な損害を与える可能性があります。 AIが生成したフィッシングとBECの誘惑AI が生成したフィッシングや BEC (ビジネスメール詐欺) の餌とは、AI 技術を使用して生成された偽のメール、メッセージ、またはその他の形式の通信を指します。これらは、評判の良い機関、企業、サービス プロバイダー、または個人を装い、ユーザーに本物であると信じ込ませます。これらの餌は、リンクをクリックしたり、添付ファイルをダウンロードしたり、機密情報を提供したり、フォームに記入したりすることで従業員を騙し、機密のビジネス情報や機密の財務データを入手したり、違法な送金を行ったりします。 詐欺師は非常にリアルな詐欺手法を使用するため、従業員が詐欺を見破ることは難しく、要求が正当かつ合理的であると誤って信じてしまいます。 人工知能技術の応用により、フィッシングや BEC のベイト攻撃はより混乱を招き、隠蔽性が増し、ユーザーが真正性を見分けることがより困難になります。 AI によって生成されたフィッシングや BEC のルアーには、次のような「利点」がよくあります。

この攻撃手法に対応するため、企業は従業員教育を強化し、効果的なセキュリティ管理と監視を実施し、BEC ベイト攻撃を防ぐための重要な対策として内部報告メカニズムを確立する必要があります。 ディープフェイクディープフェイクは、人の声、表情、体の動きを偽のコンテンツに合成する人工知能技術です。主な方法は、生成的敵対ネットワークの機械学習モデルを使用して、画像またはビデオをソース画像またはビデオにマージして重ね合わせ、ニューラルネットワーク技術を使用して大規模なサンプル学習を実行し、偽造の目的を達成することです。 ディープフェイクの最も一般的な形式は AI による顔変更技術ですが、音声シミュレーション、顔合成、ビデオ生成なども含まれます。その出現により、非常にリアルで判別が困難な音声や動画コンテンツを改ざんまたは生成することが可能となり、最終的には観察者が肉眼で真偽を判別できなくなります。 今日、ChatGPT はディープフェイク攻撃を理論上の脅威から現実の脅威へと変えました。 犯罪者がこのディープフェイク技術を利用して企業や個人を攻撃した場合、国家の安全や公共の安全が脅かされるだけでなく、偽の動画を拡散したり、社会紛争を激化させたり、暴力やテロ行為を扇動したり、競合国の諜報機関に干渉したり、行動範囲を制限する条件を設定したりするために利用される可能性もあります。同時に、この技術は、動画の顔を変える技術のハードルを下げることにもなります。ディープフェイク技術を使えば、悪意のある人間が他人の身元を簡単に誘拐したり盗んだりすることができます。ディープフェイク技術は、リベンジポルノ、商業的名誉毀損、恐喝、サイバー攻撃、犯罪などの違法行為を実行するための新しいツールになる可能性さえあります。 結論今日、AI がもたらす脅威はすでに迫っています。人工知能の応用範囲が拡大し続けるにつれて、新しい攻撃手法が絶えず出現しています。新たな AI 攻撃は、個人、企業、そして社会全体に大きなリスクと危険をもたらします。 一方、AI は、ネットワークの可視性、異常検出、脅威の自動化のための強力なツールとなり得ます。その一方で、AI はハッカーがシステムに侵入してデータを盗むための邪悪な力にもなり得ます。 ネットワーク セキュリティの攻撃と防御のゲームにおいて、AI は「天使」であり「悪魔」でもあります。したがって、AI をバランスよく制御する方法が重要です。 AI とサイバーセキュリティは、互いに影響し合う密接に関連した 2 つの分野です。 AI技術を活用することで、ネットワークのセキュリティを向上させ、データやデバイスを攻撃や破壊から守ることができますが、同時に、AI自体がもたらす課題やリスクにも注意を払い、適切な対策を講じる必要があります。 AIの発展は私たちに前例のない可能性をもたらしましたが、同時に人々は警戒を怠らず、技術自体の限界を認識する必要があります。技術、法律、教育などの手段を組み合わせることによってのみ、安全で信頼できるネットワーク環境を構築することができます。 |

<<: チームメイトが機械の場合: CISO が AI について尋ねるべき 8 つの質問

>>: IBMとNASAが炭素排出量追跡のためのオープンソースAIモデルを発表

推薦する

数百万人の乗客を「迅速に配達」する人工知能の応用

ほとんどの人がテイクアウトを注文しており、今ではテイクアウトは中国人にとってもう一つの食事方法となっ...

ディープラーニングフレームワークの簡単な歴史: TFとPyTorchは二大勢力であり、次の10年は黄金時代を迎える

過去 10 年間で、機械学習 (特にディープラーニング) の分野では多数のアルゴリズムとアプリケーシ...

待望のAI実装はどこで行き詰まっているのでしょうか?

AIはこれまで3つの発展の波を経験してきました。最初の2つの波は当時の技術環境やその他の理由により...

Omdia、2019年の世界IoT分野における重要な投資をまとめる

市場調査会社オムディアの最新の調査レポートによると、モノのインターネットの「誇大宣伝サイクル」のピー...

ネットワークセキュリティ運用保守サービスにおける人工知能の応用

近年、国内外のサイバーセキュリティ情勢はますます複雑化しており、従来のモデルでは国民経済の生命線に関...

自動車の自動運転産業チェーンに関する詳細な調査レポート: 自動運転はどこに向かっているのか?

(レポート制作者/執筆者:国金証券、翟偉)レポートの概要産業チェーンと市場空間:中国の自動運転は現...

とにかく車に乗ってください! DriveVLM: オリンが導入した初の高速・低速デュアルシステムインテリジェント運転モデル

この記事は、Heart of Autonomous Driving の公開アカウントから許可を得て転...

6つのチャットボット構築プラットフォーム

チャットボットは今日、多くの企業にとって顧客サービスの基盤として急速に定着しつつあります。そして、企...

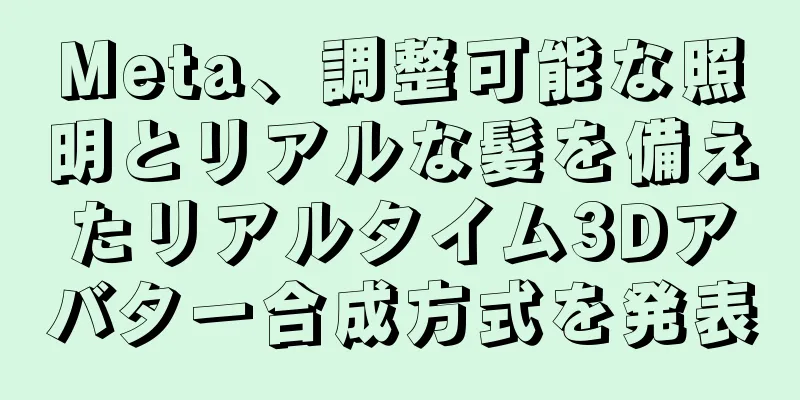

マイクロソフトは「間違いから学ぶ」モデルトレーニング方法を発表し、「人間の学習プロセスを模倣し、AIの推論能力を向上させる」ことができると主張している。

IT Homeは11月7日、マイクロソフトリサーチアジアが北京大学、西安交通大学などの大学と共同で...

Python vs R: 機械学習とデータ分析の比較

[[187351]]新しいツールの出現を促すために、機械学習やデータ分析の分野は「オープンソース」の...

大規模ナレッジグラフデータストレージの実践的分析

1. ナレッジグラフとは何ですか?現実世界にはさまざまなものが存在します。物事の間にはいくつかの種類...