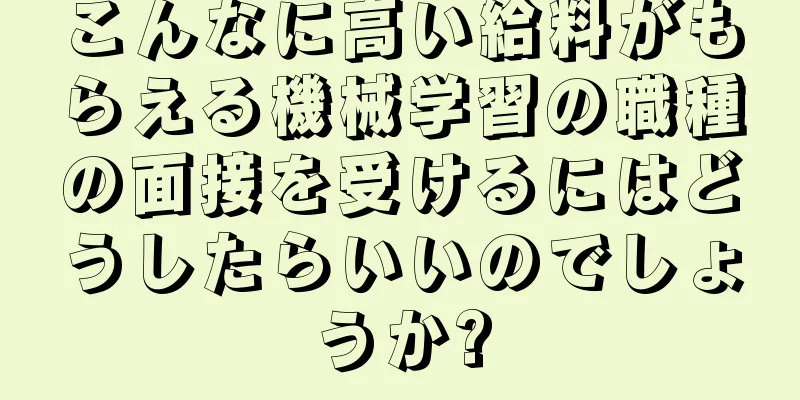

ビッグモデルの「錯覚」、この記事を読んでください

|

ビッグモデルの「幻想」がついに体系的にレビューされました! 49 ページの記事では、幻覚の定義、分類、原因、幻覚を検出して軽減する方法について詳しく説明しています。 この最新のレビューはハルビン工業大学とファーウェイによるもので、投稿されるとすぐにオンラインで非常に人気を博しました。 具体的には、本論文では新しいカテゴリーフレームワークを使用してモデル錯覚を定義し、それを事実錯覚と忠実性錯覚の 2 つのカテゴリーに分類します。 さらに、モデルの幻覚の 3 つの主な原因であるデータ ソース、トレーニング プロセス、および推論をまとめ、幻覚を軽減するための対応する戦略を示します。 写真のプレビュー、こんな感じです。 明確で理解しやすいです。現在、関連ツイートの閲覧回数は15万回を超え、シェア、いいね、コレクションは2,000回を超えている。ネットユーザーからは次のようなコメントが寄せられている。

別のネットユーザーのコメントは素晴らしかった。 興味深いことに、この論文は非常に長いため、ChatGPT を使用して読む必要があります。 幻覚は、大規模モデルに共通する「問題」です。根本原因がわかれば、適切な解決策を処方しやすくなります。 北京大学の数学教授である董斌氏はかつて、研究者としては実は大きなモデルの錯覚を好む、と語ったことがある。 なぜなら、幻想と創造/革新の間には実際にはわずかな境界線しかないからです。 では、このレビューでは、大規模モデル錯視の現象を具体的にどのように分析するのでしょうか?見てみましょう。 巨大模型の幻覚「病理」ビッグモデルは幻覚を起こしているが、それは単なる「でたらめ」だ。 記事の言葉を借りれば、これはモデルによって生成されたコンテンツが現実世界の事実やユーザー入力と一致しない現象を指します。 前述のように、研究者は大規模モデル幻覚を事実幻覚と忠実性幻覚に分類します。 △左、事実の幻覚、右、忠実の幻覚事実の幻覚は、モデルによって生成されたコンテンツが検証可能な現実世界の事実と一致しない場合に発生します。 たとえば、モデルに「月面を歩いた最初の人物は誰ですか?」と質問すると、モデルは「チャールズ・リンドバーグは、1951 年の月面開拓ミッションで初めて月面に着陸した人物です」と答えます。実際、月面を歩いた最初の人物はニール・アームストロングでした。 事実に基づく幻覚は、事実上の矛盾(現実世界の情報と矛盾するもの)と事実上の捏造(まったく存在せず、現実世界の情報に基づいて検証できないもの)に分けられます。 忠実度の錯覚とは、モデルによって生成されたコンテンツがユーザーの指示やコンテキストと一致していないという事実を指します。 たとえば、今年 10 月のニュースを要約するようにモデルに指示すると、モデルは 2006 年 10 月に起こった出来事について話していることがわかります。 忠実度の錯覚は、指示の不一致 (出力がユーザーの指示から逸脱する)、コンテキストの不一致 (出力がコンテキスト情報と一致しない)、論理の不一致 (推論手順と最終的な答えが一致しない) の 3 つのカテゴリに分類することもできます。 では、大きなモデルが幻覚を生み出す理由は何でしょうか? まず「病は口から」であり、ビッグモデルの食事データが幻覚を引き起こす大きな原因です。 これらには、データの不備や、データに記録された事実知識の活用率の低さなどが含まれます。 具体的には、データの欠陥は誤情報とバイアス(繰り返しバイアス、社会的バイアス)に分けられます。また、大規模モデルには知識の境界もあるため、ドメイン知識の欠陥や事実知識の古さも存在します。 大規模なモデルが大量のデータを消費する場合でも、使用時に問題が発生する可能性があります。 大規模なモデルでは、場所の近接性、共起統計、関連するドキュメント数など、トレーニング データ内のいくつかのパターンに過度に依存し、幻覚を引き起こす可能性があります。たとえば、「カナダ」と「トロント」がトレーニング データ内で頻繁に共起する場合、大規模なモデルではトロントをカナダの首都と誤って識別する可能性があります。 さらに、大規模なモデルではロングテールの知識の想起が不十分になる可能性があり、複雑な推論を処理するのが困難になる可能性があります。 データに加えて、トレーニングプロセスによって大規模なモデルに幻覚が生じる可能性もあります。 問題は主に、事前トレーニング段階(大規模モデルが一般的な表現を学習し、世界に関する知識を獲得する)とアライメント段階(大規模モデルを微調整して、人間の好みとより一致するようにする)の 2 つの段階で発生します。 事前トレーニング段階には以下が含まれます。

調整フェーズには以下が含まれます。

大規模モデルの幻覚における 3 番目の重要な要素は推論ですが、これには 2 つの問題があります。

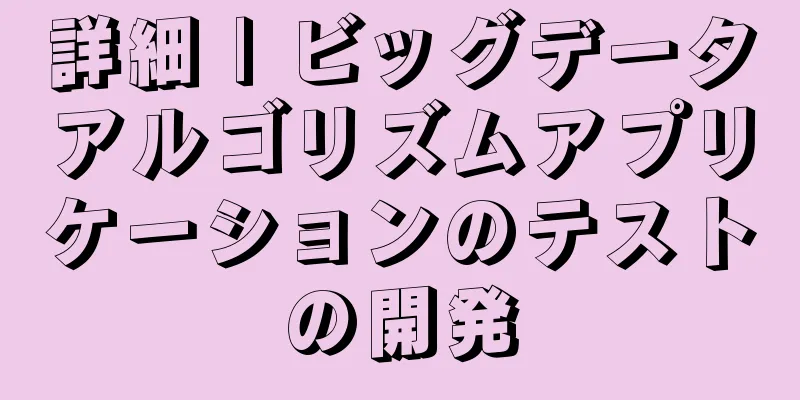

大規模モデル疾患の検出研究者らは、大規模なモデルにおける幻覚の原因を分析した後、モデルによる幻覚検出のベンチマークも提供した。 事実の幻覚には、外部事実を取得する方法と不確実性を推定する方法の 2 つの既存の方法があります。 外部の事実を取得するには、モデルが生成したものを信頼できる知識源と比較する必要があります。 不確実性推定に基づく幻覚検出方法は、内部状態ベースの方法と動作ベースの方法の 2 つのカテゴリに分けられます。 内部状態ベースの方法は、主に大規模なモデルの内部状態へのアクセスに依存します。たとえば、モデルの不確実性は、主要な概念の最小ラベル付け確率を考慮して決定されます。 動作ベースの方法は、主に、内部状態にアクセスせずに大規模モデルの動作を観察することに依存します。たとえば、幻覚は、複数の応答をサンプリングし、事実の記述の一貫性を評価することによって検出されます。 研究者たちは、忠実度の錯覚を検出するための 5 つの異なる方法を 1 つの図にまとめました。

幻覚を測定する方法がわかったので、幻覚を軽減する方法を検討することができます。 適切な薬で幻覚を治療する研究者らは、幻覚の原因に基づいて幻覚の緩和に関する既存の研究を詳細にまとめた。 1. データに関する錯覚。誤報や偏見を減らす最も直感的な方法は、高品質の事実データを収集し、データクリーニングを実行して偏見を排除することです。 知識の境界の問題に対する一般的なアプローチは 2 つあります。 1 つは知識編集であり、モデル パラメータを直接編集して知識ギャップを埋めます。もう 1 つは、検索拡張生成 (RAG) を通じて非パラメトリックな知識ソースを活用するものです。 検索強化には、1 回限りの検索、反復的な検索、および事後検索の 3 つのタイプがあります。 ワンショット検索では、単一の検索から取得した外部知識が大規模モデルのプロンプトに直接事前設定されます。反復検索では、生成プロセス全体を通じて知識を継続的に収集できます。後検索は、大規模モデルの出力を改善するための検索の修正に基づいています。 2. トレーニングに関連した幻覚。欠陥のあるモデルアーキテクチャは幻覚の原因に基づいて改善することができ、関連する研究も数多くあります。 モデルの事前トレーニングに関しては、最新の進歩は、事前トレーニング戦略を改善し、より豊かなコンテキスト理解を確保し、バイアスを回避することによってこの問題に対処しようと試みてきました。 たとえば、モデルの文書ベースの非構造化事実知識の断片的で関連性のない理解に対処するために、いくつかの研究では、文書内の各文の後に TOPICPREFIX を追加して、それらを独立した事実に変換し、それによってモデルによる事実関係の理解を強化しました。 さらに、人間の嗜好判断と起動ガイダンスを改善することで、アライメントのずれの問題を軽減することができます。 3. 推論に関連する幻覚。不完全なデコードにより、モデル出力が元のコンテキストから逸脱することがよくあります。 研究者らは、事実強化デコードと編集後デコードという2つの高度な戦略を検討した。 さらに、忠実度強化デコードでは、ユーザーの指示や提供されたコンテキストとの一貫性を優先し、生成されたコンテンツの一貫性の向上を重視します。既存の研究は、文脈の一貫性と論理の一貫性の 2 つのカテゴリにまとめることができます。 文脈の一貫性に関する最新の研究の 1 つに、コンテキスト認識デコード (CAD) があります。これは、事前知識への依存を減らすことで出力分布を変更し、モデルがコンテキスト情報に注意を払うように促します。 論理的一貫性に関する最近の研究には、思考連鎖プロンプトに内在する自己一貫性を強化するための知識蒸留フレームワークが含まれています。 論文リンク: https://arxiv.org/abs/2311.05232 |

<<: 13Bモデルはあらゆる面でGPT-4を圧倒しますか?この裏にあるトリックは何でしょうか?

推薦する

北京大学の新しい研究では、数学モデルを使用して、インターネット有名人の台頭の秘密を明らかにしています。ネイチャー誌に掲載

ソーシャル ネットワークは私たちの生活にますます大きな影響を与えており、情報の普及、新しいテクノロジ...

たった今、アリババが重大な技術的爆弾を発表しました!

人類史上のスーパープロジェクトとは何でしょうか?ピラミッド、万里の長城、ドバイワールドアイランド、三...

軽量ディープラーニングフレームワーク Tinygrad

Tinygrad は、ニューラル ネットワークを理解して実装するためのシンプルで直感的なアプローチ...

シングルトランスフォーマー情報検索、Google は微分可能な検索インデックスでデュアルエンコーダーモデルに勝利

情報検索 (IR) は、インターネットの誕生以来、揺るぎない地位を築いてきました。膨大なデータからユ...

LoRAShear: LLM プルーニングと知識回復に関する Microsoft の最新研究

LoRAShear は、言語モデリング (LLM) を最適化し、知識を保存するために Microso...

スクリーンはあなたの運命を変えることはできません! AI教育で裸で泳いでいるのは誰ですか? 16社が摘発される

[[252632]]はじめに:最近、「このスクリーンはあなたの運命を変えるかもしれない」という記事が...

2019 年のトップ 5 ディープラーニング コース

現在、ディープラーニングはデータサイエンスの分野で最も人気のあるスキルとなっています。ディープラーニ...

ディープ ニューラル ネットワークを構築するための 20 の「未熟な」ヒント

当社の機械学習ラボでは、数多くの高性能マシンで何万時間ものトレーニングを行って豊富な経験を蓄積してき...

データが人工知能の基盤となる理由

データ注釈とは何ですか?ほとんどのデータはラベル付けされておらず、非構造化データですが、人工知能のト...

Uni-TTS音声合成モデルのアップグレード:1つの音声、複数の言語、高忠実度、高効率

最近、マイクロソフトは最新の Azure ニューラル ネットワーク音声合成技術 Uni-TTSv3 ...

Xiaohongshu プッシュ検索シナリオにおける計算能力のボトルネックを打破するために機械学習の異種ハードウェア推論を最適化する方法!

この記事では、Xiaohongshu プッシュ検索シナリオの完全な GPU 構築プロセスにおけるモデ...