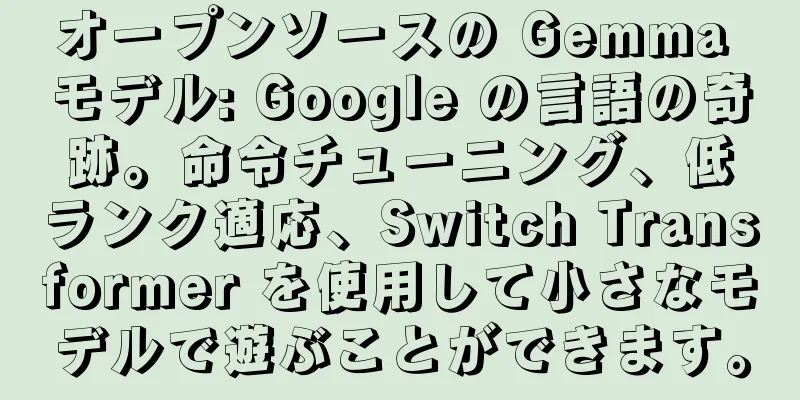

オープンソースの Gemma モデル: Google の言語の奇跡。命令チューニング、低ランク適応、Switch Transformer を使用して小さなモデルで遊ぶことができます。

|

言語は人間にとって最も重要なコミュニケーションツールであり、人工知能の分野における最も挑戦的な研究対象でもあります。機械に自然言語を理解させ、生成させる方法は、人工知能の中心的な課題であり、人間の知性の重要な象徴です。近年、ディープラーニングの発展により、ニューラルネットワークに基づく自然言語処理技術である言語モデル(LM)は目覚ましい成果を上げています。 言語モデルの開発は、統計モデルからニューラル ネットワーク モデルへと移行してきましたが、その中で最も代表的なのは、Transformer に基づく大規模事前トレーニング済み言語モデル (LLM) です。 Transformer は、長距離の依存関係を効果的に処理し、モデルの並列性と効率性を向上させることができる、Self-Attention Mechanism に基づくニューラル ネットワーク アーキテクチャです。 Transformer ベースの LLM は、大量のラベルなしテキストを事前トレーニングすることで豊富な言語知識と意味表現を学習し、その後、特定の下流タスクを微調整することでさまざまな分野やシナリオに適応します。 Transformer ベースの LLM の代表的なものとしては、BERT、GPT、XLNet、T5 などがあります。これらは、さまざまな自然言語処理タスクで大幅なパフォーマンス向上を達成し、自然言語処理の新たな波を先導しました。 Transformer ベースの LLM にも、主に次の点でいくつかの課題と制限があります。 1) モデルサイズの拡大により、コンピューティング リソースとストレージ スペースに対する需要が増大します。モデルの表現力と一般化機能を向上させるために、Transformer ベースの LLM では、モデル パラメーターとレイヤーの数を数百万から数十億、さらには数兆まで増やし続けています。その結果、モデルのトレーニングと推論には大量のコンピューティング リソースとストレージ スペースが必要となり、モデルの展開と使用のコストと難易度が増大します。 2) モデルの事前トレーニングと微調整のプロセスに効果的なガイダンスとフィードバックが欠けています。トランスフォーマーベースの LLM は通常、マスク言語モデル (MLM) や自己回帰言語モデル (ARLM) などの教師なし目的関数を使用して事前トレーニングされます。これらの目的関数は、テキストのローカル情報のみを利用し、テキストの全体的な構造とセマンティクスは無視します。微調整プロセスでは、モデルは下流のタスクのラベルに従ってのみ調整できます。モデル出力に関する効果的なガイダンスとフィードバックが不足しているため、モデル出力がユーザーの期待とニーズを満たさない可能性があります。 3) モデルの一般化と適応性を向上させる必要がある。 Transformer ベースの LLM は事前トレーニング段階で多くの言語知識を学習していますが、さまざまな下流のタスクやフィールドに直面したときに優れたパフォーマンスを達成するには、まだ多くの微調整が必要です。つまり、モデルの一般化と適応性は限られており、新しい、または複雑な言語現象やシナリオをうまく処理できません。 写真 これらの問題に対処するため、Google は最近、新しいオープンソース モデルのセットである Gemma をリリースしました。これは、Google Gemini モデルの作成に使用された研究とテクノロジーに基づいて構築された軽量モデルです。 Gemma モデルには 2B と 7B の 2 つのサイズがあり、それぞれ 20 億と 70 億のパラメータを持ち、テキスト生成、質問応答、対話、感情分析などのさまざまな自然言語処理タスクに使用できます。 Gemma モデルは、低ランク適応 (LoRA) と呼ばれる手法を使用しており、モデル出力の品質を維持しながら、微調整に必要なパラメータの数とトレーニング時間を大幅に削減できます。 Gemma モデルでは、命令チューニング (IT) と呼ばれる手法も使用されており、ユーザーが提供する命令を通じてモデルの動作と出力を制御し、より柔軟でカスタマイズ可能なテキスト生成を実現します。 Gemma モデルは Kaggle によってホストされており、ユーザーは Kaggle でアクセスをリクエストし、関連する利用規約に同意する必要があります。ユーザーは、JAX、Keras、PyTorch、Transformers などのさまざまなバックエンドとフレームワークを使用して Gemma モデルにアクセスし、使用することもできます。 ガートナーのアナリスト、チラグ・デカテ氏は、グーグルの新しいモデルは2024年が小規模言語モデル(SLM)と大規模言語モデルの年であることを示していると述べた。 「GenAIの時代では、企業がLLMだけでなく、自社にとって重要で自社のデータのコンテキストに即した低価格のSLMからも価値を生み出せることが重要になります」とデカルト氏は語った。 コンステレーション・リサーチの創設者であるR.「レイ」・ワン氏は、言語モデルが小さくなることで企業はより高い精度を達成できると述べた。 01 ジェマモデルの背景Gemma モデルの背景は、Google Gemini モデルの研究開発にまで遡ります。 Geminiは、Googleが2020年末にリリースした新しいタイプの大規模事前学習済み言語モデルです。1012億のパラメータを持ち、当時世界最大の言語モデルでした。 Gemini モデルの目標は、対話、要約、翻訳、質疑応答など、さまざまな自然言語処理タスクやシナリオで使用できる一般的な言語理解および生成機能を実現することです。 Gemini モデルには、Switch Transformer と呼ばれる新しいニューラル ネットワーク アーキテクチャが搭載されており、モデルのサイズと複雑さを動的に調整してさまざまな入力と出力に適応できるため、モデルの効率と柔軟性が向上します。 Gemini モデルでは、Mixture of Experts (MoE) と呼ばれる手法も使用されており、モデルのパラメータを複数のエキスパート モジュールに分散することで、モデルの容量と表現力が向上します。 Gemini モデルの研究開発により、Google には多くの新しいテクノロジーと経験がもたらされ、Google の他の製品やサービスに対するサポートと支援も提供されました。たとえば、Google アシスタントは会話機能と質問回答機能を向上させるために Gemini モデルの一部を使用し、Google 翻訳は翻訳の品質と速度を向上させるために Gemini モデルの一部を使用し、Google 検索は検索の関連性と精度を向上させるために Gemini モデルの一部を使用します。しかし、Gemini モデルの規模と複雑さは、主に次の点で Google にいくつかの課題と困難をもたらしました。 Gemini モデルのトレーニングと推論には、膨大なコンピューティング リソースとストレージ スペースが必要ですが、これはほとんどのユーザーや開発者の手の届かないものです。 Gemini モデルのトレーニングには数千個の TPU チップが必要で数週間かかりますが、推論には数百個の TPU チップが必要で数秒しかかかりません。つまり、ジェミニ モデルの使用と展開には高いコストと複雑なテクノロジが必要となり、一般の個人や企業には適さないことになります。 Gemini モデルの事前トレーニングおよび微調整プロセスには効果的なガイダンスとフィードバックが不足しており、モデル出力がユーザーの期待やニーズを満たさない可能性があります。 Gemini モデルは、事前トレーニング段階で MLM や ARLM などの教師なし目的関数を使用します。これらの目的関数は、テキストのローカル情報のみを利用し、テキストの全体的な構造と意味は無視します。微調整プロセス中、モデルは下流のタスクのラベルに従ってのみ調整でき、モデル出力に関する効果的なガイダンスとフィードバックが不足しています。その結果、モデルの出力がユーザーの期待やニーズを満たさなくなる可能性があります。たとえば、モデルが無関係または不合理なテキストを生成したり、モデルが特定の指示やシナリオを処理できない可能性があります。 Gemini モデルの一般化と適応性は改善する必要があり、新しい、または複雑な言語現象やシナリオをうまく処理できません。 Gemini モデルは事前トレーニング段階で多くの言語知識を学習していますが、さまざまな下流のタスクや分野に直面したときに優れたパフォーマンスを達成するには、まだ多くの微調整が必要です。これは、モデルの一般化と適応性が限られており、新しいまたは複雑な言語現象やシナリオをうまく処理できないことを意味します。たとえば、モデルが一部の特殊な用語や略語を理解できなかったり、モデルが特定のテキスト タイプやスタイルを生成できなかったりする場合があります。 これらの問題に対処するため、Google は Gemini モデルの研究と技術に基づいて、一連の新しいオープン モデルを開発しました。Gemma は、テキスト生成、質問への回答、対話、感情分析など、さまざまな自然言語処理タスクに使用できる軽量で柔軟な言語モデルです。 Gemma モデルの革新は主に次の点にあります。 Gemma モデルは、低ランク適応 (LoRA) と呼ばれる手法を使用しており、モデル出力の品質を維持しながら、微調整に必要なパラメータの数とトレーニング時間を大幅に削減できます。 LoRA は低ランク行列分解に基づく技術であり、モデルの重み行列を 2 つの小さな行列の積に分解して、モデルの複雑さと冗長性を削減します。 LoRA は、さまざまなタスクやシナリオに適応するためにモデルのサイズと複雑さを動的に調整できるため、モデルの効率と柔軟性が向上します。 Gemma モデルは、LoRA の 2 つのバリエーション、LoRA-IT と LoRA-PT を使用します。これらは、それぞれ命令のチューニングと事前トレーニングに使用されます。 LoRA-IT はモデルパラメータの数を 99.9% 削減でき、LoRA-PT はモデルパラメータの数を 99.5% 削減できます。 Gemma モデルは、命令チューニング (IT) と呼ばれる手法を使用しており、ユーザーが提供する命令を通じてモデルの動作と出力を制御し、より柔軟でカスタマイズ可能なテキスト生成を実現します。ディレクティブは、ユーザーの期待と要件を記述するために使用される自然言語表現であり、モデルの目標、制約、スタイルなどを指定できます。命令チューニングは、トレーニングと推論中に命令を使用してモデルの学習と生成をガイドし、モデルの品質と多様性を向上させる命令ベースの微調整方法です。 Gemma モデルは、会話における役割、順番、指示を表すために Gemma 形式と呼ばれる特別な表記システムを使用し、それによってモデルを効果的に制御できるようにします。 Gemma モデルは、Switch Transformer と呼ばれる新しいニューラル ネットワーク アーキテクチャを使用します。このアーキテクチャは、モデルのサイズと複雑さを動的に調整してさまざまな入力と出力に適応できるため、モデルの効率と柔軟性が向上します。 Switch Transformer は、Mixture of Experts (MoE) と呼ばれる手法を使用する Transformer ベースのアーキテクチャであり、モデルのパラメータを複数のエキスパート モジュールに分散することで、モデルの容量と表現力を高めます。 Switch Transformer は Router と呼ばれるテクノロジも使用します。このテクノロジは、入力機能に基づいて適切なエキスパート モジュールを動的に選択できるため、モデルの計算オーバーヘッドとストレージ要件が削減されます。 写真 図 1: Llama 2 や Mistral 7B などの人気モデルと比較すると、Gemma はサイズの面でパフォーマンスの新しい基準を設定します。 02 ジェマモデルの原則Gemma モデルの原理には、主に低ランク適応、命令チューニング、スイッチ トランスフォーマーの 3 つの側面が含まれます。以下では、これら 3 つの側面の原則と詳細をそれぞれ紹介します。 低ランク適応低ランク適応 (LoRA) は、低ランク行列分解に基づく手法であり、モデルの重み行列を 2 つの小さな行列の積に分解して、モデルの複雑さと冗長性を削減できます。低ランク適応の基本的な考え方は、モデルの重み行列を低ランク行列、つまり行列の次元よりもはるかに小さいランクを持つ行列として近似的に表現できるというものです。低ランク行列は、2 つの小さい行列の積で表すことができます。たとえば、mxn 行列 W は、mxr 行列 U と rxn 行列 V の積として表すことができます。つまり、W = UV です。ここで、r は m より小さい正の整数で、n は行列のランクと呼ばれます。この方法では、mn パラメータの代わりに 2mr パラメータを使用できるため、パラメータの数とモデルのストレージ スペースを削減できます。同時に、低ランク行列はモデルの冗長性とノイズを削減し、モデルの一般化能力と安定性を向上させることもできます。 低ランク適応における重要な問題は、行列のランク、つまり r の値をどのように決定するかです。 r が小さすぎると、低ランク行列が元の行列をうまく近似できず、モデルのパフォーマンスが低下する可能性があります。r が大きすぎると、低ランク行列が元の行列をうまく圧縮できず、モデル効率が低下する可能性があります。したがって、最適なバランスを実現するには、さまざまなタスクやシナリオに応じて r の値を動的に調整する必要があります。 Gemma モデルは Adaptive Rank と呼ばれる技術を使用しており、入力特徴と出力ターゲットに基づいて適切な r の値を自動的に選択し、モデルの動的な調整を実現します。具体的には、Gemma モデルは Adaptive Rank と呼ばれる技術を使用しており、入力特徴と出力ターゲットに基づいて適切な r の値を自動的に選択し、モデルの動的な調整を実現します。具体的には、Gemma モデルは、Rank Predictor と呼ばれる追加のニューラル ネットワークを使用します。このニューラル ネットワークは、単語の頻度、品詞、単語の意味などの入力特徴に基づいて各重み行列の最適な r 値を予測し、これらの値を低ランク行列分解のパラメーターとして使用して低ランク重み行列を取得します。このように、Gemma モデルはさまざまなタスクやシナリオに応じてモデルのサイズと複雑さを動的に調整し、最適なバランスを実現します。 Gemma モデルは、命令の調整と事前トレーニングに、それぞれ LoRA-IT と LoRA-PT と呼ばれる 2 つの異なる低ランク適応のバリエーションを使用します。 LoRA-IT は、モデルのパラメータ数を 20 億または 70 億から 130 万または 450 万に 99.9% 削減できる、命令チューニング用の低ランク適応方法です。 LoRA-IT の主なアイデアは、モデルの重み行列を固定の元の重み行列とトレーニング可能な低ランク行列の 2 つの部分に分解し、これら 2 つの部分を追加して最終的な重み行列を取得することです。このようにして、モデルは元の重み行列の情報を保持しながら、低ランク行列を通じて微調整され、さまざまな指示に適応することができます。 LoRA-PT は、事前トレーニング用の低ランク適応法であり、モデルのパラメータ数を 20 億または 70 億から 1 億または 3 億 5000 万に 99.5% 削減できます。 LoRA-PT の主なアイデアは、モデルの重み行列を固定の低ランク行列とトレーニング可能な残差行列の 2 つの部分に分解し、これら 2 つの部分を加算して最終的な重み行列を取得することです。このようにして、低ランク行列を使用してモデルを事前トレーニングし、残差行列を使用して微調整してさまざまなタスクに適応させることができます。 命令のチューニング命令チューニング (IT) は、ユーザーが提供する命令を通じてモデルの動作と出力を制御できる命令ベースの微調整方法であり、より柔軟でカスタマイズ可能なテキスト生成を実現します。ディレクティブは、ユーザーの期待と要件を記述するために使用される自然言語表現であり、モデルの目標、制約、スタイルなどを指定できます。たとえば、ユーザーは次の種類の指示を提供できます。

命令チューニングの主な考え方は、ユーザーが提供する命令をモデルの入力の一部として使用し、それによってモデルの学習と生成をガイドして、モデルの出力がユーザーの期待とニーズを満たすようにすることです。命令チューニングプロセスは、トレーニング段階と推論段階の 2 つの段階に分かれています。トレーニング段階では、指示とラベルが付いたいくつかのサンプルを使用してモデルが微調整され、さまざまな指示に基づいてさまざまなテキストを生成する方法を学習します。推論フェーズでは、モデルはユーザーが提供する指示と入力に基づいて対応するテキストを生成します。命令の調整を実現するために、Gemma モデルでは、会話における役割、順番、および命令を表すために、Gemma 形式と呼ばれる特別な表記システムを使用します。 Gemma 形式では、<start_of_turn>、<end_of_turn>、user、model の 4 つの特殊な制御トークンと、<start_of_response> や <end_of_response> などのオプションの補助トークンが使用されます。 Gemma 形式の例は次のとおりです。 <start_of_turn>ユーザー 春についての詩を書いてください<end_of_turn> <start_of_turn>モデル 春が来て、花が咲き、鳥が歌い、ミツバチが飛び回り、太陽が輝き、空は青く、春が来て、あなたも来てください<end_of_turn> スイッチトランスSwitch Transformer は、Transformer をベースにした新しいニューラル ネットワーク アーキテクチャであり、モデルのサイズと複雑さを動的に調整してさまざまな入力と出力に適応できるため、モデルの効率と柔軟性が向上します。 Switch Transformer の主な特徴は、Mixture of Experts (MoE) と呼ばれる手法の使用です。この手法は、モデルのパラメータを複数のエキスパート モジュールに分散し、モデルの容量と表現力を向上させます。 MoE は、複数の異なるモデルをより強力なモデルに組み合わせるアンサンブル学習に基づく手法です。 MoE の基本的な考え方は、さまざまなモデルがさまざまなサブタスクまたはサブフィールドに焦点を当てることができるため、モデルの専門性と多様性が向上するというものです。 MoE における重要な課題は、さまざまなモデルに入力をどのように割り当てるか、つまり適切な専門家をどのように選択するかです。 Switch Transformer は、入力機能に基づいて適切なエキスパート モジュールを動的に選択できる Router と呼ばれるテクノロジを使用して、モデルの計算オーバーヘッドとストレージ要件を削減します。ルーターは、単語の頻度、品詞、単語の意味などの入力特徴に基づいて各エキスパート モジュールの重みを予測し、これらの重みに基づいて入力を 1 つ以上のエキスパート モジュールに割り当てて、最終的な出力を取得する追加のニューラル ネットワークです。 Switch Transformer の利点の 1 つは、モデルのサイズと複雑さを動的に調整してさまざまな入力と出力に適応できるため、モデルの効率と柔軟性が向上することです。たとえば、一般的な単語やフレーズなどの単純な入力の場合、Switch Transformer は少数のエキスパート モジュールのみを使用するため、コンピューティング リソースと時間を節約できます。一方、まれな単語や長い文などの複雑な入力の場合、Switch Transformer はより多くのエキスパート モジュールを使用できるため、モデルの表現力と品質が向上します。 Switch Transformer のもう 1 つの利点は、モデルの容量と表現力を高め、それによってモデルの一般化と適応性を向上させることができることです。たとえば、新しい、または複雑な言語現象やシナリオの場合、Switch Transformer はさまざまなエキスパート モジュールを利用して、モデルの専門性と多様性を向上させることができます。 図 2: 同様のサイズのオープン モデルと比較した、さまざまな機能における Gemma 7B の言語理解および生成パフォーマンス。標準的な学業ベンチマーク評価を能力別にグループ化し、そのスコアを平均しました。(詳細については技術文書の表6を参照) 03 ジェマモデルの応用と展望Gemma モデルは、テキスト生成、質問への回答、会話、感情分析など、さまざまな自然言語処理タスクに使用できる強力で柔軟な言語モデルです。 テキスト生成テキスト生成とは、特定の入力に基づいて一貫したテキストを自動的に生成するタスクを指します。作成、教育、エンターテイメント、ビジネスなど、さまざまなシナリオで使用できます。 Gemma モデルは、ユーザーが提供する指示と入力に基づいて、詩、物語、コード、記事、歌詞など、さまざまなタイプとスタイルのテキストを生成できます。 Gemma モデルの利点は、指示を通じて調整できるため、テキスト生成を柔軟かつカスタマイズして制御でき、ユーザーのさまざまな期待やニーズを満たすことができることです。たとえば、ユーザーはテキストの主題、内容、長さ、スタイル、制約などを指定して、自分の希望により適したテキストを取得できます。 Gemma モデルのもう 1 つの利点は、さまざまなタスクやシナリオに適応するための低ランク適応を通じて、テキスト生成を効率的かつ迅速に微調整できることです。たとえば、ユーザーはさまざまなバックエンドやデバイスを使用して、さまざまなプラットフォームやフレームワーク上の Gemma モデルにすばやくアクセスして使用できるため、テキスト生成の効率と利便性が向上します。 質問と回答質問応答とは、ユーザーが提起した質問に基づいて、適切な回答を自動的に提供するタスクを指します。科学、歴史、文化、生活など、さまざまな分野で活用できます。 Gemma モデルは、ユーザーからの質問に基づいて簡潔で正確な回答を生成したり、ユーザーの問題解決に役立つ関連情報やリソースを提供したりできます。 Gemma モデルの利点は、事前トレーニング段階で学習した大量の言語知識と意味表現を活用して、質問応答の品質と精度を向上できることです。たとえば、Gemma モデルはさまざまな質問タイプと難易度を理解できるため、回答の形式や詳細レベルも異なります。 Gemma モデルのもう 1 つの利点は、命令の調整を活用して Q&A を柔軟かつカスタマイズ可能な制御を実現し、ユーザーのさまざまな期待やニーズを満たすことができることです。たとえば、ユーザーは質問の分野、範囲、ソース、言語などを指定して、自分の希望に合った回答を得ることができます。 対話ダイアログとは、ユーザーとモデル間のやりとりに基づいて首尾一貫した会話を自動的に生成するタスクを指し、コンサルティング、エンターテイメント、教育、ソーシャルインタラクションなどのさまざまな目的に使用できます。 Gemma モデルは、ユーザーとモデル間のやり取りに基づいて自然で興味深い会話を生成したり、関連するサービスや提案を提供してユーザーの体験と満足度を高めたりすることができます。 Gemma モデルの利点は、事前トレーニング段階で学習した大量の言語知識と意味表現を活用して、会話の質と流暢さを向上できることです。たとえば、Gemma モデルはさまざまな会話の種類とシナリオを理解し、さまざまな会話戦略とスタイルを提供できます。 Gemma モデルのもう 1 つの利点は、コマンド チューニングを活用して会話を柔軟かつカスタマイズ可能に制御し、ユーザーのさまざまな期待やニーズに対応できることです。たとえば、ユーザーは会話の目的、トピック、役割、感情などを指定して、自分の希望に合った会話を実現できます。 感情分析感情分析とは、ユーザーが入力したテキストに基づいて、テキストの感情の傾向や強度を自動的に判断するタスクを指します。コメント、フィードバック、世論、推奨事項など、さまざまなアプリケーションで使用できます。 Gemma モデルは、ユーザーが提供したテキストに基づいて簡潔で正確な感情分析結果を生成したり、ユーザーが自分の感情状態を理解して改善するのに役立つ関連する提案やフィードバックを提供したりできます。 Gemma モデルの利点は、事前トレーニング段階で学習した大量の言語知識と意味表現を活用して、感情分析の品質と精度を向上できることです。たとえば、Gemma モデルはさまざまなテキストの種類とスタイルを理解し、それによってさまざまな感情ラベルとスコアを付与できます。 Gemma モデルのもう 1 つの利点は、コマンドを使用して調整し、感情分析を柔軟かつカスタマイズ可能に制御して、ユーザーのさまざまな期待やニーズに対応できることです。たとえば、ユーザーはテキストの分野、範囲、ソース、言語などを指定して、より希望に沿った感情分析結果を得ることができます。 Gemma モデルは、テキスト生成、質問への回答、会話、感情分析など、さまざまな自然言語処理タスクに使用できる強力で柔軟な言語モデルです。 Gemma モデルの革新には、主に、低ランク適応、命令チューニング、スイッチ トランスフォーマーなどの側面が含まれます。低ランク適応は、低ランク行列分解に基づく手法であり、モデル出力の品質を維持しながら、微調整に必要なパラメータの数とトレーニング時間を大幅に削減できます。命令チューニングは、ユーザーが提供する命令を通じてモデルの動作と出力を制御できる命令ベースの微調整方法であり、より柔軟でカスタマイズ可能なテキスト生成を実現します。 Switch Transformer は、Transformer をベースにした新しいニューラル ネットワーク アーキテクチャであり、モデルのサイズと複雑さを動的に調整してさまざまな入力と出力に適応できるため、モデルの効率と柔軟性が向上します。 Gemma モデルの原理には、主に低ランク適応、命令チューニング、スイッチ トランスフォーマーの 3 つの側面が含まれます。低ランク適応の基本的な考え方は、モデルの重み行列を 2 つの小さな行列の積に分解し、それによってモデルの複雑さと冗長性を削減することです。命令チューニングの主な考え方は、ユーザーが提供する命令をモデルの入力の一部として使用し、それによってモデルの学習と生成を導き、モデルの出力がユーザーの期待とニーズを満たすようにすることです。 Switch Transformer の主な特徴は、Mixture of Experts (MoE) と呼ばれる手法の使用です。この手法は、モデルのパラメータを複数のエキスパート モジュールに分散し、モデルの容量と表現力を向上させます。 Gemma モデルのアプリケーションと展望には、主にテキスト生成、質問応答、対話、感情分析などの側面が含まれます。テキスト生成とは、特定の入力に基づいて一貫したテキストを自動的に生成するタスクを指します。作成、教育、エンターテイメント、ビジネスなど、さまざまなシナリオで使用できます。質問応答とは、ユーザーが提起した質問に基づいて、適切な回答を自動的に提供するタスクを指します。科学、歴史、文化、生活など、さまざまな分野で活用できます。ダイアログとは、ユーザーとモデル間のやりとりに基づいて首尾一貫した会話を自動的に生成するタスクを指し、コンサルティング、エンターテイメント、教育、ソーシャル インタラクションなどのさまざまな目的に使用できます。 Gemma モデルは、ユーザーとモデル間のやり取りに基づいて自然で興味深い会話を生成したり、関連するサービスや提案を提供してユーザーの体験と満足度を高めたりすることができます。感情分析とは、ユーザーが入力したテキストに基づいて、テキストの感情の傾向や強度を自動的に判断するタスクを指します。コメント、フィードバック、世論、推奨事項など、さまざまなアプリケーションで使用できます。 Gemma モデルは、ユーザーが提供したテキストに基づいて簡潔で正確な感情分析結果を生成したり、ユーザーが自分の感情状態を理解して改善するのに役立つ関連する提案やフィードバックを提供したりできます。 Gemma モデルは、テキスト生成、質問への回答、会話、感情分析など、さまざまな自然言語処理タスクに使用できる強力で柔軟な言語モデルです。 Gemma モデルの革新、原理、アプリケーション、展望は、人工知能分野における Google の最新の進歩と革新を反映しており、ユーザーと開発者にさらに多くの選択肢と機会を提供します。 Gemma モデルの利点は、低ランク適応、命令チューニング、スイッチトランスフォーマーを通じてモデルの動的な調整、柔軟な制御、効率的な操作を実現し、モデルのパフォーマンスと品質を向上させ、ユーザーのさまざまな期待とニーズを満たすことができることです。 Gemma モデルの課題は、モデルの汎用性と一般化能力を確保しながら、さまざまなタスクやシナリオに適応し、さまざまな言語現象やシナリオを処理する必要があり、それによってモデルの専門性と多様性を向上させることです。 Gemma モデルの展望は、継続的な研究開発、モデルのアーキテクチャとテクノロジーの最適化、モデルのアプリケーションと分野の拡大を通じて、モデルの影響力と価値を向上させることができることです。 要約すると、Gemma モデルは、テキスト生成、質問への回答、会話、感情分析など、さまざまな自然言語処理タスクに使用できる強力で柔軟な言語モデルです。 Gemma モデルの革新、原理、応用、展望はすべて、私たちが深く理解し、活用する価値があります。 Gemma モデルは、人工知能の分野における Google の重要な貢献であるだけでなく、言語の理解と生成に関する重要な探求でもあります。 (終わり) 参考文献:1. https://ai.google.dev/gemma/docs 2. https://storage.googleapis.com/deepmind-media/gemma/gemma-report.pdf |

<<: 推薦システムにおけるランキング学習のための独自のアルゴリズム: Schiram ランキング

>>: Google AI ビデオがまた大ヒット!オールラウンドなユニバーサルビジュアルエンコーダーであるVideoPrismに30のSOTAパフォーマンスアップデートが実装されました

推薦する

人類の生存に関わる問題ですか? AI システムの説明可能性を調査する理由は何ですか?

この記事は公開アカウント「Reading Core Technique」(ID: AI_Discov...

顔認識技術の応用の安全管理に関する規定(試行)コメント:1万人以上の顔情報の保管は中国サイバースペース管理局に登録する必要がある

8月8日、IT Homeは中国サイバースペース事務局から、顔認識技術の応用を標準化するため、「中華人...

マスク氏とアルトマン氏がともに暗号通貨を復活させたい理由

著者 | プリタム・ボルドロイ徐潔成編纂暗号通貨は死んだのか?この質問に対する答えは、誰が答えるかに...

AI研究機関OpenAIがライティングAIを開発:十分にリアルなフェイクニュースを書く

北京時間2月15日朝のニュース、ブルームバーグ通信によると、マスク氏が提唱するAI研究機関OpenA...

Google は Gen-2 を殴り、ピカを蹴り、大規模な AI ビデオ モデルを開発するために 7 か月間懸命に取り組みました。時空構造の最初の言及、持続時間は壮大なレベルにまで延長される

AIビデオトラックでは、Googleが再び衝撃的なアップデートをリリースしました! Google L...

なぜ中国はアメリカや日本を抜いて人工知能で世界をリードしているのでしょうか?

[[279809]]北京は世界で最も人工知能企業が集中している都市であり、中国の人工知能分野は世界...

量子機械学習変分量子分類器 (VQC) の紹介

変分量子分類器 (VQC) は、量子コンピューティング技術を使用して分類タスクを実行する機械学習アル...

MIT は Google と提携して 7 台のマルチタスク ロボットをトレーニングし、9,600 のタスクで 89% の成功率を達成しました。

タスクの数が増えるにつれて、現在の計算方法を使用して汎用の日常的なロボットを構築するコストは法外なも...

2020年のディープラーニング開発のレビュー

近年の傾向に倣い、ディープラーニングは 2020 年も最も急速に成長している分野の 1 つであり続け...

世界の自動運転「M&A」を4大勢力が攻勢

偉大な将軍の名声の裏には、数え切れないほどの兵士たちの援助がある。この声明は自動運転の分野にも当ては...

ウェアラブル AI が IoT に与える影響

ウェアラブル人工知能がモノのインターネット (IoT) の発展に与える影響を探ります。デジタル時代の...

ChatGPT、画像や動画コンテンツを生成するCanvaプラグインをリリース

9月4日、ChatGPT Plusサブスクリプションサービスで独自のCanvaプラグインがリリースさ...